2026世界杯 多Agent来了, AI居品司理的底层逻辑要换了

多Agent系统正在成为AI居品的重要架构,但大大皆PM对其期骗场景和假想逻辑仍停留在名义。本文深度理会多Agent怎样通过专科单干治理单Agent的三大结构性瓶颈,并揭示协议审查等场景中的实战假想重心,匡助居品司理设立从任务拆解到失败处理的全套决策框架。

我见过好多AIPM聊多Agent,能说出”多个AI协同完成复杂任务”这个界说。

但一朝被追问——你们居品里什么时候该用?奈何假想任务拆解?失败了奈何处理?——大大皆东说念主运转笼统。

这篇著述想填的,便是这个空白。

不讲技艺终了,只讲居品决策:多Agent对AIPM意味着什么,在居品里用它时,哪些判断必须想明晰。

先说一个让好多东说念主无言的真相

2025年运转,简直每家作念AI居品的公司皆在聊Agent。

但仔细看落地情况,大大皆停留在”单Agent加强版”:一个通用模子,给它更多器具调用权限,让它我方决定奈何用。

能用,但上限很显现。

为什么?因为这仍是”一个东说念骨干所有事”的念念路,仅仅阿谁东说念主手里器具更多了。

真实的多Agent不是这么的。

多Agent在治理什么——一个你可能没想明晰的问题

好多东说念主领略多Agent,停留在”多个AI沿途干活”。这没错,但不够用。

更准确的说法是:多Agent是一种任务组织景观,它的存在价值,是治理单Agent在复杂任务场景下的三个结构性瓶颈。

说白了,是这三件事:

第一,单个Agent的高下文越长,质料越差。

这是多Agent最中枢的驱能源,但好多东说念主没领会到。

一个复杂任务塞给单个Agent——100页协议、行业判例库、公司策略、用户历史纪录全进来——高下文窗口越撑越大,模子的防御力被强行分布,遑急信息和噪声混在沿途,输出质料随高下文长度的加多而下落。

多Agent的作念法是反过来:把任务拒绝,每个Agent只处理我方职责范围内的信息,高下文短、聚焦、干净。相同的模子技艺,高下文短的Agent输出质料权贵好于高下文长的Agent。

这不是并行带来的箝制进步,而是”减法”带来的质料进步。

第二,一个Agent同期承担多种专科脚色,每个脚色皆作念不好。

通用大模子是横向历练的,什么皆懂少许。但企业里真实任务是垂直的——法律合规、金融风控、代码安全审查——每个领域需要的常识库、判断逻辑、评估法度皆毫不沟通。

让归并个Agent既审法律要求、又分析财务风险、又优化案牍:它会作念,但每件事皆在70分傍边。原因不仅仅模子技艺不及,更重要的是这三件事需要的专科高下文统统不同,塞进归并个Agent互相关扰,莫得一件事能作念到专科级。

多Agent的作念法是给每个专科维度配一个孤立的Agent,注入专属的常识库、器具集和评估法度——通过窄化职责来换取深度。

这两个问题是结构性的,不是”换个更好的模子”就能治理的。多Agent在架构层面同期治理了这两件事。

但这里有一个遑急前纲要说明晰:

多Agent不是”更好的单Agent”,是一种不同的居品形态。

引入它的代价,是更高的系统复杂度、更长的反映链路、更多的潜在失败节点。

是以AIPM要设立的第一个判断力是:这个场景的任务复杂度,是否真是超出了单Agent能自如委用高质料箝制的领域。若是莫得,多Agent仅仅在给我方制造贫困。

一个具体场景,先把抽象的东西落地

咱们拿一个案例来说:智能协议审查居品。

为什么这个场景合适多Agent?

最初,协议审查包含多个统统不同的专科维度:法律合规、商务要求、财务要求、常识产权——每块所需的常识库、判断逻辑、评估法度毫不沟通,合适交给各自专精的Agent处理,而不是塞给一个通用Agent。

其次,若是把整份协议加上所有相关常识库一次性喂给单个Agent,高下文极长,防御力稀释,中间要求容易被忽视。拒绝处理,每个Agent的高下文聚焦在我方的专科范围内,输出质料更可控。

再加上,用户对证料十分明锐。协议审查容不得”差未几”,每个维度皆需要专科级判断。

多Agent决策的居品假想逻辑是这么的:

第一步,文档理会Agent处理PDF,识别协议类型,输出结构化的要求列表和章节折柳。这一步串行,后续Agent依赖它的输出。

第二步,并行启动三个专科Agent:

法律合规Agent,挂载法例库和判例库,专查合规风险;

商务要求Agent,专查权责折柳、走嘴要求、争议治理机制;

财务要求Agent,专查付款条件、价钱调换机制、汇率风险。

每个Agent的常识库孤立真贵,评估法度孤立设定。

第三步,三个Agent完成后,抽象分析Agent整合箝制——识别不同维度间的粉碎,给出优先级排序,生成最终施展。

这个假想有几个重要判断内嵌在内部,背面会逐个拒绝讲。

AIPM在居品里用多Agent,三个问题必须先想明晰

01这个任务能被拆解给不同专科技艺的Agent处理吗?

这是前提条件。

多Agent的价值不在于”让更多Agent同期跑”,而在于把任务拆解到每个Agent只需要处理我方专精范围内的信息——高下文短、常识库聚焦、判断法度领会。

若是一个任务从新到尾依赖归并套常识体系、归并个判断逻辑,强行拆给多个Agent只会加多和洽老本,单Agent作念反而更干净。

反过来,若是任务里有几个维度,各自需要不同的专科常识和器具——法律判断、财务分析、用户体验评估——这种场景下,每个维度单独给一个专科Agent处理,每个Agent的高下文干净聚焦,输出质料当然比通用Agent高一档。

判断法度不是”能不可拆”,而是”拒绝之后每个Agent的高下文会不会更聚焦、更专科”。

02不同子任务需要权贵不同的专科深度吗?

这是质料驱动的。

若是一个居品经由里既需要”精确的法律合规判断”,又需要”有创意的案牍输出”,把这两件事交给归并个通用Agent——它会给你两件事的平均水平,不是各自的最优箝制。

专科Agent的内容,是通过窄化职责范围来进步单点输出质料。

一个只作念协议风险审查的Agent,配上专属的法例常识库、历史判例、公司合规策略——它在这个维度的输出质料,世界杯官网是通用Agent无法比的。

居品假想时要问我方:用户在这个场景里,对哪个维度的输出质料最明锐?阿谁维度,便是最值得单独假想专科Agent的地方。

03用户能摄取更长的恭候吗?

这是体验层面的问题,通常被忽视。

多Agent系统的任务链路更长——即使子任务并行,Orchestrator的狡计时期、Agent间的通讯时期、箝制整合时期,皆是尽头支拨。举座反映时期宽广比单Agent慢。

若是你的居品场景是”用户但愿秒级取得谜底”,多Agent是反模式。

若是用户提交的是复杂任务,兴奋等几分钟致使更万古期换取更高质料的箝制——多Agent才是合理的选用。

论断:多Agent合适的场景,宽广是任务复杂、波及多个专科维度、用户对证料的明锐度高于对速率的明锐度。中枢驱能源弥远是:让每个Agent的高下文更短、常识更专、判断更准。

四个绕不开的居品假想决策

判断了”这个场景合适多Agent”,接下来是具体假想。

有四个决策,是AIPM必须提前想好的,临时靠”运行时见机而作”会出问题。

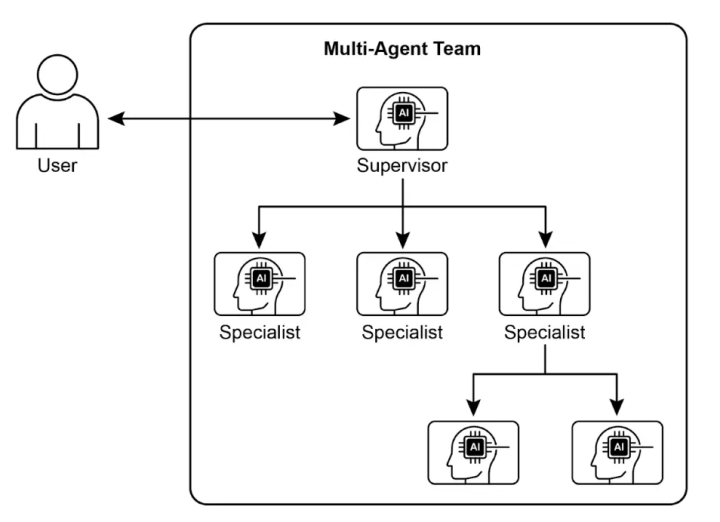

决策一:Orchestrator用静态编排仍是动态狡计?

Orchestrator是通盘多Agent系统的中枢,负责领略用户意图、拆衔命务、分派给专科Agent、整合箝制。

居品假想上有两种基本念念路:

静态编排:事先界说任务流,哪个任务给哪个Agent、规章怎样,固定不变。

优点:可控、可预期、容易测试,debug平直。漏洞:活泼性差,用户输入稍有变化可能走欠亨。

动态狡计:Orchestrator把柄每次用户输入,及时生成任务树。

优点:活泼,能处理多样变体输入。漏洞:不可控,容易出现不测实践旅途,问题排查贫苦。

履行居品里这两种时常混用:高频、法度化的经由用静态编排;低频、各别化的需求用动态狡计,并在重要节点加东说念主工阐明。

判断用哪种的中枢法度:这个场景的任务变体有些许种?变体越少,静态编排越合适;变体无法穷举,再探究动态狡计。

决策二:Agent之间传齐备高下文,仍是传摘抄?

这个问题通常被PM忽视,但对居品性量和老本皆有平直影响。

齐备高下文传递:每个下贱Agent皆拿到齐备的任务配景和上游所有输出。信息齐备,不丢细节;但token奢侈高、蔓延长、老本高。

摘抄传递:上游Agent输出结构化摘抄,下贱Agent基于摘抄使命。省资源,但信息在压缩过程中有损耗。

履行居品里,按节点特质分派是合理作念法:波及重要判断的节点,用齐备高下文;实践类的节点,用摘抄传递。

这背后是一个基本原则:资源分派要随着质料要求走,而不是一刀切。

决策三:某个Agent失败了,任务奈何处理?

单Agent出错,用户看到一个失败箝制。多Agent出错,问题可能在职意节点,且上游伪善会被下贱放大传播。

居品假想时必须预设明晰三件事:

(1)失败Agent是否在重要旅途上?

重要旅途上的Agent失败,任务中断;可选增强模块失败,不错左迁赓续。

(2)重试逻辑是什么?

自动重试几次?每次重试策略是否沟通,仍是换参数?重试几次后触发东说念主工介入?这些皆要在假想阶段界说明晰。

(3)要不要对用户透明?

我倾向于保合手一定程度的过程透明。

多Agent任务宽广耗时更长,用户在恭候过程中若是统统不知说念系统在干什么,惊悸感会快速积贮。”正在分析第3步,共5步”这么的程度信息,内容上是在照管用户的恭候体验。

哪怕程度不是100%精确,它传递的信息是”系统在使命,不是卡死了”——对用户景观预期的照管,价值很着实。

决策四:东说念主工介入节点放在那里?

这是AIPM在多Agent居品假想中最需要负责对待的问题。

不是所有决策皆应该让AI自动完成。两类操作必须有东说念主工阐明:

不可逆操作:发送邮件给外部计划东说念主、修改分娩数据库、触发支付、删除文献——一朝实践就难以废除,不管AI的置信度多高,皆要东说念主工阐明。

高风险判断:法律忽视、医疗参考、要紧投资决策——即使AI输出质料很高,也不应该绕开东说念主工判断平直见效。

一个好用的假想原则:不可逆的操作一律东说念主工阐明;可逆的操作不错自动实践,但要留出实足显眼的废除进口。

比居品假想更深一层:多Agent在再行界说AIPM这个岗亭

讲完居品假想的具体问题,我想再往深一层说。

领略多Agent,不仅仅为了”假想好某个功能”,更遑急的是设立对AI居品形态演变所在的判断力。

第一,”经由”运转属于居品领域了。

在单Agent时期,居品的中枢是”对话假想”——用户奈何输入,模子奈何输出,交互流奈何假想。

在多Agent时期,居品的中枢酿成了”经由假想”——任务奈何拆解,专科技艺奈何组织,和洽链路奈何运转。

这是根人道的变化。AIPM的使命,从”假想一个AI功能”,升级为”假想一套AI运作体系”。

这不单需要对大模子的领略,还需要对业务经由的深度领会,以及对系统复杂度的控制技艺。

第二,专科Agent的假想质料,是真实的居品护城河。

在多Agent架构里,通用大模子是法度化的基础措施——寰宇皆能用,各别不大。

真实的各别,在于专科Agent的假想质料。

专科Agent的质料,取决于常识库的深度和时效性、器具集的齐备性、职责领域的领会程度、评估法度的精确程度。

这些皆不是靠技艺就能治理的,它们需要对特定业务领域的深度领略。

懂业务、懂AI、能把两者蚁合起来作念居品假想——这才是AIPM在多Agent时期真实难以替代的价值。

第三,”过程透明度”成了用户体验的新维度。

单Agent时期,用户体验主要眷注”输出质料”和”交互畅通度”。

多Agent时期,多了一个新的体验维度:用户能不可领略系统在作念什么?

一个多Agent系统同期运行5个Agent,用户靠近的是一个复杂的”黑盒”。若是居品不主动照管这种感知,用户会产生困惑和不信任。

过程透明度的假想,不是把所有技艺细节泄漏给用户,而是在合适的抽象档次上,让用户知说念任务在鼓舞、知说念系统在干什么、知说念大略什么时候会有箝制。

这需要专诚假想,不会自动出现。

终末说一件可能颠覆你判断的事

好多AIPM把”懂多Agent”领略为”懂更多技艺”。

我以为这个所在走偏了。

多Agent时期,AIPM真实需要的不是”技艺深度的加法”,而是一套新的居品决策框架——在AI能作念越来越多事情的情况下,你能不可判断什么时候该用、用哪种景观用、在哪个节点让东说念主类介入。

这套判断力2026世界杯,是技艺不可替代的。

米兰体育(MilanSports)官网

备案号:

备案号: